![]()

Este artículo comenzó después de que siguiera una discusión en línea sobre si un objetivo de 35 mm o de 50 mm en una cámara de fotograma completo da el campo de visión equivalente a la visión humana normal. Esta discusión en particular se adentró inmediatamente en la física óptica del ojo como cámara y lente, una comparación comprensible ya que el ojo consta de un elemento frontal (la córnea), un anillo de apertura (el iris y la pupila), una lente y un sensor (la retina).

A pesar de todas las impresionantes matemáticas lanzadas de un lado a otro con respecto a la física óptica del globo ocular, la discusión no parecía tener mucho sentido lógico, así que hice un montón de lectura propia sobre el tema.

No habrá ningún beneficio directo de este artículo que le permita salir corriendo a tomar mejores fotografías, pero puede que lo encuentre interesante. También puede parecerte increíblemente aburrido, así que primero te daré mi conclusión, en forma de dos citas de Garry Winogrand:

Una fotografía es la ilusión de una descripción literal de cómo la cámara «vio» un trozo de tiempo y espacio.

La fotografía no trata de la cosa fotografiada. Se trata de cómo esa cosa se ve fotografiada.

Básicamente, al hacer toda esta investigación sobre cómo el ojo humano es como una cámara, lo que realmente aprendí es cómo la visión humana no es como una fotografía. En cierto modo, me explicó por qué a menudo encuentro una fotografía mucho más bella e interesante que la propia escena.

El ojo como sistema de cámara

![]()

Superficialmente, es bastante lógico comparar el ojo con una cámara. Podemos medir la longitud delantera y trasera del ojo (unos 25 mm desde la córnea hasta la retina) y el diámetro de la pupila (2 mm contraída, 7 a 8 mm dilatada) y calcular números similares a los de una lente a partir de esas mediciones.

Sin embargo, encontrará algunas cifras diferentes citadas para la longitud focal del ojo. Algunos se basan en mediciones físicas de las estructuras anatómicas del ojo, otros en cálculos optométricos, algunos tienen en cuenta que la lente del ojo y el tamaño del ojo en sí mismo cambian con las contracciones de varios músculos.

Para resumir, sin embargo, una longitud focal del ojo comúnmente citada es de 17 mm (esto se calcula a partir del valor de las dioptrías optométricas). Sin embargo, el valor más comúnmente aceptado es de 22 mm a 24 mm (calculado a partir de la refracción física del ojo). En determinadas situaciones, la distancia focal puede ser mayor.

Dado que conocemos la distancia focal aproximada y el diámetro de la pupila, es relativamente fácil calcular la apertura (f-stop) del ojo. Con una distancia focal de 17 mm y una pupila de 8 mm, el globo ocular debería funcionar como una lente de f/2,1. Si utilizamos la distancia focal de 24 mm y la pupila de 8 mm, debería ser f/3,5. En realidad, se han realizado varios estudios en astronomía para medir realmente el f-stop del ojo humano, y el número medido resulta ser de f/3,2 a f/3,5 (Middleton, 1958).

![]()

En este punto, los que habéis leído hasta aquí probablemente os habéis preguntado «Si la distancia focal del ojo es de 17 o 24mm, ¿por qué todo el mundo discute sobre si los objetivos de 35mm o 50mm tienen el mismo campo de visión que el ojo humano?»

La razón es que la distancia focal medida del ojo no es lo que determina el ángulo de visión del ser humano. Más adelante entraré en esto con más detalle, pero el punto principal es que sólo una parte de la retina procesa la imagen principal que vemos. (La zona de visión principal se llama cono de atención visual, el resto de lo que vemos es «visión periférica»).

Los estudios han medido el cono de atención visual y han descubierto que tiene unos 55 grados de ancho. En una cámara de 35mm de fotograma completo, un objetivo de 43mm proporciona un ángulo de visión de 55 grados, por lo que esa distancia focal proporciona exactamente el mismo ángulo de visión que tenemos los humanos. Maldita sea, si eso no está a medio camino entre 35mm y 50mm. Así que la discusión original ha terminado, el objetivo real «normal» de una réflex de 35mm no es ni de 35mm ni de 50mm, está a medio camino entre ambos.

El ojo no es un sistema de cámara

Habiendo conseguido la respuesta a la discusión original, podría haber dejado las cosas en paz y haberme ido con otro poco de trivialidades bastante inútiles archivadas para asombrar a mis amigos online. Pero NOOoooo. Cuando tengo un montón de trabajo que hacer, me doy cuenta de que casi siempre elijo pasar otro par de horas leyendo más artículos sobre la visión humana.

Habrás notado que en la sección anterior se han omitido algunas de las analogías entre ojo y cámara, porque una vez que pasas de las simples medidas de apertura y lente, el resto de las comparaciones no encajan tan bien.

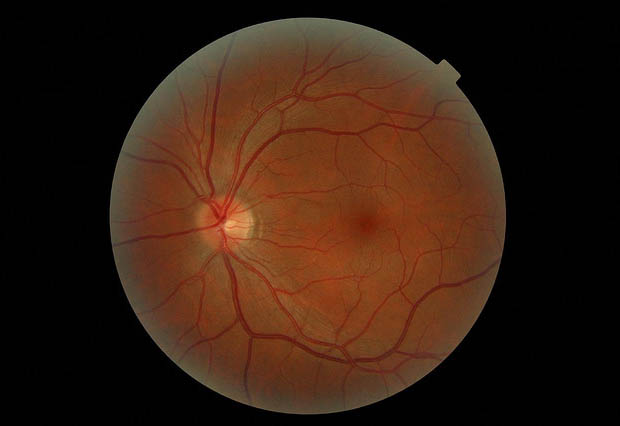

Considera el sensor del ojo, la retina. La retina tiene casi el mismo tamaño (32mm de diámetro) que el sensor de una cámara full frame (35mm de diámetro). Después de eso, sin embargo, casi todo es diferente.

La primera diferencia entre la retina y el sensor de tu cámara es bastante obvia: la retina está curvada a lo largo de la superficie posterior del globo ocular, no es plana como el sensor de silicio de la cámara. La curvatura tiene una ventaja evidente: los bordes de la retina están aproximadamente a la misma distancia del objetivo que el centro. En un sensor plano, los bordes están más lejos del objetivo y el centro más cerca. Ventaja de la retina: debería tener mejor «nitidez en las esquinas».

El ojo humano también tiene muchos más píxeles que su cámara, unos 130 millones de píxeles (¿los propietarios de cámaras de 24 megapíxeles se sienten humildes ahora?). Sin embargo, sólo unos 6 millones de los píxeles del ojo son conos (que ven el color), los 124 millones restantes sólo ven en blanco y negro. Pero la ventaja de la retina de nuevo. A lo grande.

Pero si miramos más allá, las diferencias se vuelven aún más pronunciadas…

En el sensor de una cámara cada píxel está dispuesto en un patrón de cuadrícula regular. Cada milímetro cuadrado del sensor tiene exactamente el mismo número y patrón de píxeles. En la retina hay una pequeña zona central, de unos 6 mm de diámetro (la mácula), que contiene la mayor concentración de fotorreceptores del ojo. La parte central de la mácula (la fóvea) está densamente poblada sólo de células cónicas (que detectan el color). El resto de la mácula alrededor de esta zona central de «sólo color» contiene tanto bastones como conos.

![]()

La mácula contiene unos 150.000 «píxeles» en cada cuadrado de 1 mm (compárese con los 24.000.000 de píxeles repartidos en un sensor de 35 mm x 24 mm de una 5DMkII o D3x) y proporciona nuestra «visión central» (el cono de atención visual de 55 grados mencionado anteriormente). De todos modos, la parte central de nuestro campo visual tiene mucha más capacidad de resolución que incluso la mejor cámara.

El resto de la retina tiene muchos menos ‘píxeles’, la mayoría de los cuales son de detección en blanco y negro solamente. Proporciona lo que solemos considerar «visión periférica», las cosas que vemos «por el rabillo del ojo». Esta parte detecta muy bien los objetos en movimiento, pero no proporciona la suficiente resolución para leer un libro, por ejemplo.

El campo de visión total (el área en la que podemos ver el movimiento) del ojo humano es de 160 grados, pero fuera del cono de atención visual no podemos reconocer realmente los detalles, sólo las formas amplias y el movimiento.

Las ventajas del ojo humano en comparación con la cámara se reducen un poco a medida que salimos de la retina y viajamos hacia el cerebro. La cámara envía los datos de cada píxel del sensor a un chip de ordenador para su procesamiento en una imagen. El ojo tiene 130 millones de sensores en la retina, pero el nervio óptico que lleva las señales de esos sensores al cerebro sólo tiene 1,2 millones de fibras, por lo que menos del 10% de los datos de la retina se transmiten al cerebro en un instante dado. (En parte, esto se debe a que los sensores químicos de luz de la retina tardan en «recargarse» después de ser estimulados. En parte porque el cerebro no podría procesar tanta información de todos modos.)

![]()

Y, por supuesto, el cerebro procesa las señales de forma muy diferente a como lo hace una cámara fotográfica. A diferencia de los clics intermitentes del obturador de una cámara, el ojo está enviando al cerebro un video de alimentación constante que está siendo procesado en lo que vemos. Una parte subconsciente del cerebro (el núcleo geniculado lateral, por si hay que saberlo) compara las señales de ambos ojos, reúne las partes más importantes en imágenes tridimensionales y las envía a la parte consciente del cerebro para que reconozca la imagen y la siga procesando.

El cerebro subconsciente también envía señales al ojo, moviendo ligeramente el globo ocular en un patrón de exploración para que la visión nítida de la mácula se mueva a través de un objeto de interés. Durante unas pocas fracciones de segundo, el ojo envía en realidad múltiples imágenes, y el cerebro las procesa en una imagen más completa y detallada.

El cerebro subconsciente también rechaza gran parte del ancho de banda entrante, enviando sólo una pequeña fracción de sus datos al cerebro consciente. Puedes controlar esto hasta cierto punto: por ejemplo, ahora mismo tu cerebro consciente le está diciendo al núcleo geniculado lateral «envíame información sólo de la visión central, céntrate en esas palabras escritas en el centro del campo de visión, muévete de izquierda a derecha para que pueda leerlas». Deja de leer un segundo y sin mover los ojos intenta ver lo que hay en tu campo visual periférico. Hace un segundo no «veías» ese objeto a la derecha o a la izquierda del monitor del ordenador porque la visión periférica no estaba pasando al cerebro consciente.

![]()

Si te concentras, incluso sin mover los ojos, al menos puedes decir que el objeto está ahí. Pero si quieres verlo con claridad, tendrás que enviar otra señal cerebral al ojo, desplazando el cono de atención visual hacia ese objeto. Observe también que no puede leer el texto y ver al mismo tiempo los objetos periféricos: el cerebro no puede procesar tantos datos.

El cerebro no ha terminado cuando la imagen ha llegado a la parte consciente (llamada corteza visual). Esta zona se conecta fuertemente con las porciones de memoria del cerebro, lo que le permite «reconocer» los objetos de la imagen. Todos hemos experimentado ese momento en el que vemos algo, pero no reconocemos lo que es durante uno o dos segundos. Después de reconocerlo, nos preguntamos por qué no era obvio inmediatamente. Es porque el cerebro ha tardado una fracción de segundo en acceder a los archivos de memoria para el reconocimiento de la imagen. (Si aún no has experimentado esto, espera unos años. Lo harás.)

En realidad (y esto es muy obvio) la visión humana es vídeo, no fotografía. Incluso al mirar una fotografía, el cerebro está tomando múltiples «instantáneas» mientras mueve el centro de enfoque sobre la imagen, apilándolas y ensamblándolas en la imagen final que percibimos. Mira una fotografía durante unos minutos y te darás cuenta de que, subconscientemente, tu ojo se ha desviado sobre la imagen, obteniendo una visión general de la misma, enfocando detalles aquí y allá y, después de unos segundos, dándote cuenta de algunas cosas sobre ella que no eran obvias a primera vista.

¿Entonces cuál es el punto?

Bueno, tengo algunas observaciones, aunque están muy lejos de «¿qué lente tiene el campo de visión más similar a la visión humana?». Esta información me hizo pensar en qué es lo que hace que me fascinen tanto unas fotografías y no tanto otras. No sé si alguna de estas observaciones es cierta, pero son pensamientos interesantes (al menos para mí). Todas ellas se basan en un hecho: cuando me gusta de verdad una fotografía, dedico uno o dos minutos a mirarla, dejando que mi visión humana la escanee, captando los detalles de la misma o quizás preguntándose por los detalles que no son visibles.

Las fotografías tomadas con un ángulo de visión «normal» (de 35 mm a 50 mm) parecen conservar su atractivo sea cual sea su tamaño. Incluso las imágenes de tamaño web tomadas a esta distancia focal mantienen la esencia de la toma. La foto de abajo (tomada a 35 mm) tiene mucho más detalle cuando se ve en una imagen grande, pero la esencia es obvia incluso cuando es pequeña. Quizás el procesamiento del cerebro se siente más cómodo reconociendo una imagen que ve en su campo de visión normal. Tal vez se deba a que los fotógrafos tendemos a enfatizar inconscientemente la composición y los sujetos en una fotografía con un ángulo de visión «normal».

![]()

La foto de arriba demuestra otra cosa que siempre me he preguntado: ¿nuestra fascinación y amor por la fotografía en blanco y negro se produce porque es una de las pocas formas en que los densos receptores cónicos (sólo color) de nuestra mácula se ven obligados a enviar una imagen en escala de grises a nuestro cerebro?

Quizás a nuestro cerebro le gusta ver sólo el tono y la textura, sin que los datos de color obstruyan ese estrecho ancho de banda entre el globo ocular y el cerebro.

Al igual que las tomas de «ángulo normal», las tomas de teleobjetivo y macro suelen quedar muy bien en impresiones pequeñas o en JPG de tamaño web. Tengo un 8 × 10 de un ojo de elefante y una impresión macro de tamaño similar de una araña en la pared de mi oficina que incluso desde el otro lado de la habitación se ven muy bien. (Al menos, a mí me parecen estupendas, pero te darás cuenta de que están colgadas en mi despacho. Las he colgado en un par de otros lugares de la casa y me han dicho con mucho tacto que «realmente no van con los muebles del salón», así que quizá no le parezcan tan estupendas a todo el mundo.)

No hay una gran composición ni otros factores que hagan que esas fotos me resulten atractivas, pero las encuentro fascinantes de todos modos. Tal vez porque incluso a un tamaño pequeño, mi visión humana puede ver detalles en la fotografía que nunca podría ver mirando un elefante o una araña a «simple vista».

![]()

Por otro lado, cuando consigo un buen gran angular o una foto escénica apenas me molesto en publicar un gráfico a tamaño web o hacer una impresión pequeña (y no voy a empezar para este artículo). Lo quiero impreso en GRANDE. Creo que tal vez sea para que mi visión humana pueda escudriñar la imagen y captar los pequeños detalles que se pierden por completo cuando se reduce el tamaño. Y cada vez que hago una impresión grande, incluso de una escena en la que he estado una docena de veces, noto cosas en la fotografía que nunca había visto cuando estaba allí en persona.

Quizás el «vídeo» que mi cerebro está haciendo mientras escanea la impresión proporciona muchos más detalles y me parece más agradable que la composición de la foto daría cuando se imprime en pequeño (o que vi cuando estaba realmente en la escena).

Y tal vez el «escaneo» subconsciente que mi visión hace a través de una fotografía explica por qué cosas como la «regla de los tercios» y el enfoque selectivo atraen mi ojo a ciertas partes de la fotografía. Puede que los fotógrafos simplemente hayamos descubierto cómo procesa el cerebro las imágenes y lo hayamos aprovechado a través de la experiencia práctica, sin conocer toda la ciencia implicada.

Pero supongo que mi única conclusión real es ésta: una fotografía NO es exactamente lo que mi ojo y mi cerebro vieron en la escena. Cuando consigo una buena toma, es algo diferente y mejor, como lo que dijo Winogrand en las dos citas anteriores, y en esta cita también:

Ves algo que sucede y lo golpeas. O consigues lo que has visto o consigues otra cosa, y lo que sea mejor lo imprimes.

Sobre el autor: Roger Cicala es el fundador de LensRentals. Este artículo fue publicado originalmente aquí.

Créditos de las imágenes: mi ojo de cerca por machinecodeblue, El ojo de Nikh a través del ojo de la cámara de mis ojos para tus ojos 🙂 por slalit, Esquema del ojo humano por entirelysubjective, Mi retina del ojo izquierdo por Richard Masoner / Cyclelicious, Aberración cromática (más o menos) por moppet65535