![]()

Dit artikel is ontstaan nadat ik een online discussie had gevolgd over de vraag of een 35mm of een 50mm lens op een full frame camera een gezichtsveld oplevert dat gelijkwaardig is aan dat van een normaal menselijk oog. Deze specifieke discussie ging onmiddellijk in op de optische fysica van het oog als camera en lens – een begrijpelijke vergelijking aangezien het oog bestaat uit een frontelement (het hoornvlies), een diafragmaring (de iris en pupil), een lens, en een sensor (het netvlies).

Ondanks alle indrukwekkende wiskunde die over en weer werd gegooid met betrekking tot de optische fysica van de oogbol, leek de discussie niet helemaal logisch te zijn, dus heb ik zelf veel over het onderwerp gelezen.

Er zal geen direct voordeel uit dit artikel komen waardoor je betere foto’s kunt gaan maken, maar misschien vind je het interessant. Misschien vindt u het ook ontzettend saai, dus ik geef u eerst mijn conclusie, in de vorm van twee citaten van Garry Winogrand:

Een foto is de illusie van een letterlijke beschrijving van hoe de camera een stukje tijd en ruimte ‘zag’.

Fotografie gaat niet over het gefotografeerde ding. Het gaat erom hoe dat ding er gefotografeerd uitziet.

Toen ik al dat onderzoek deed over hoe het menselijk oog is als een camera, leerde ik eigenlijk dat het menselijk zicht niet is als een foto. In zekere zin verklaart dit waarom ik een foto vaak veel mooier en interessanter vind dan de scène zelf.

Het oog als camerasysteem

![]()

Op het eerste gezicht is het vrij logisch om het oog met een camera te vergelijken. We kunnen de lengte van het oog meten (ongeveer 25 mm van het hoornvlies tot het netvlies), en de diameter van de pupil (2 mm samengetrokken, 7 tot 8 mm verwijd) en op basis daarvan lensgetallen berekenen.

U zult echter verschillende getallen tegenkomen voor de brandpuntsafstand van het oog. Sommige zijn gebaseerd op fysieke metingen van de anatomische structuren van het oog, andere op optometrische berekeningen, en weer andere houden rekening met het feit dat de ooglens en de oogomvang zelf veranderen door de samentrekkingen van verschillende spieren.

Om kort te gaan, een veel geciteerde brandpuntsafstand van het oog is 17 mm (deze wordt berekend op basis van de dioptriewaarde van de optometrie). De meer algemeen aanvaarde waarde is echter 22mm tot 24mm (berekend op basis van de fysische refractie in het oog). In bepaalde situaties kan de brandpuntsafstand zelfs langer zijn.

Nadat we de brandpuntsafstand bij benadering kennen en de diameter van de pupil, is het betrekkelijk eenvoudig om de opening (f-stop) van het oog te berekenen. Bij een brandpuntsafstand van 17 mm en een pupil van 8 mm zou de oogbol moeten werken als een f/2.1 lens. Als we de 24mm brandpuntsafstand en 8mm pupil gebruiken, zou het f/3.5 moeten zijn. Er zijn in de astronomie een aantal studies gedaan om de f-stop van het menselijk oog te meten, en het gemeten getal komt uit op f/3.2 tot f/3.5 (Middleton, 1958).

![]()

U die dit tot nu toe gelezen hebben, hebben zich waarschijnlijk afgevraagd “Als de brandpuntsafstand van het oog 17 of 24 mm is, waarom maakt iedereen dan ruzie over de vraag of 35 mm of 50 mm lenzen hetzelfde gezichtsveld hebben als het menselijk oog?”

De reden hiervoor is dat de gemeten brandpuntsafstand van het oog niet bepalend is voor de beeldhoek van het menselijk zicht. Ik ga daar hieronder dieper op in, maar het belangrijkste punt is dat slechts een deel van het netvlies het hoofdbeeld verwerkt dat wij zien. (Het gebied van het hoofdzicht wordt de kegel van visuele aandacht genoemd, de rest van wat we zien is “perifeer zicht”).

Studies hebben de kegel van visuele aandacht gemeten en vastgesteld dat deze ongeveer 55 graden breed is. Op een 35mm full frame camera biedt een 43mm lens een beeldhoek van 55 graden, dus die brandpuntsafstand biedt precies dezelfde beeldhoek die wij mensen hebben. Verdomd als dat niet halverwege tussen 35mm en 50mm ligt. Het oorspronkelijke argument is dus afgedaan, de werkelijke ‘normale’ lens op een 35mm spiegelreflexcamera is noch 35mm noch 50mm, het is halverwege daartussen.

Het oog is geen camerasysteem

Nadat ik het antwoord op de oorspronkelijke discussie had gekregen, had ik de zaak kunnen laten rusten en weg kunnen lopen met weer een stukje tamelijk nutteloze trivia opgeborgen om mijn online vrienden mee te verbazen. Maar NOOOOOO. Als ik veel werk te doen heb, kies ik er bijna altijd voor om nog een paar uur door te brengen met het lezen van artikelen over het menselijk gezichtsvermogen.

Het is je misschien opgevallen dat in het bovenstaande gedeelte enkele oog-camera analogieën zijn weggelaten, want als je eenmaal voorbij de eenvoudige metingen van diafragma en lens bent, kloppen de rest van de vergelijkingen niet zo goed.

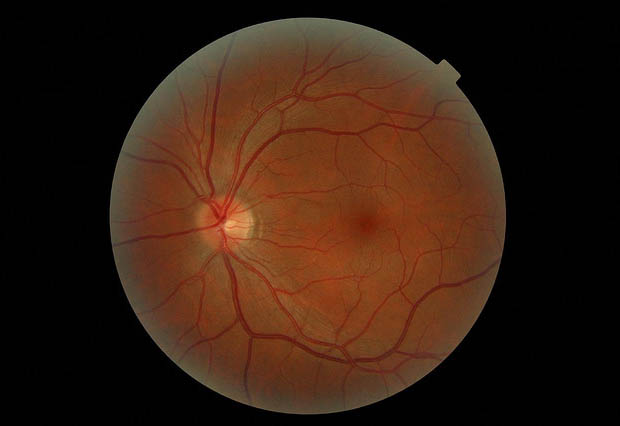

Kijk eens naar de sensor van het oog, het netvlies. Het netvlies is bijna even groot (32mm in diameter) als de sensor van een full frame camera (35mm in diameter). Daarna is echter bijna alles anders.

Het eerste verschil tussen het netvlies en de sensor van uw camera is vrij duidelijk: het netvlies is gebogen langs het achteroppervlak van de oogbol, en niet plat zoals de siliciumsensor in de camera. De kromming heeft een duidelijk voordeel: de randen van het netvlies liggen op ongeveer dezelfde afstand van de lens als het midden. Op een platte sensor zijn de randen verder van de lens verwijderd, en het centrum dichterbij. Voordeel van het netvlies – het zou een betere ‘hoekscherpte’ moeten hebben.

Het menselijk oog heeft ook veel meer pixels dan uw camera, ongeveer 130 miljoen pixels (voelen jullie je nu nederig bij 24-megapixelcamera-bezitters?). Echter, slechts ongeveer 6 miljoen van de pixels van het oog zijn kegeltjes (die zien kleur), de overige 124 miljoen zien gewoon zwart en wit. Maar weer voordeel voor het netvlies. Big time.

Maar als we verder kijken worden de verschillen nog groter…

Op een camerasensor is elke pixel uitgezet in een regelmatig rasterpatroon. Elke vierkante millimeter van de sensor heeft precies hetzelfde aantal en patroon van pixels. Op het netvlies bevindt zich een klein centraal gebied met een doorsnede van ongeveer 6 mm (de macula) dat de dichtste concentratie fotoreceptoren in het oog bevat. Het centrale gedeelte van de macula (de fovea) is dichtbevolkt met alleen kegelcellen (kleurgevoelige cellen). De rest van de macula rond dit centrale ‘alleen kleur’-gebied bevat zowel staafjes als kegeltjes.

![]()

De macula bevat ongeveer 150.000 ‘pixels’ in elk vierkantje van 1 mm (vergelijk dat met 24.000.000 pixels verdeeld over een 35mm x 24mm sensor in een 5DMkII of D3x) en zorgt voor ons ‘centrale zicht’ (de hierboven genoemde 55-gradenkegel van visuele aandacht). Hoe dan ook, het centrale deel van ons gezichtsveld heeft veel meer oplossend vermogen dan zelfs de beste camera.

De rest van het netvlies heeft veel minder ‘pixels’, waarvan de meeste alleen zwart-wit waarnemen. Het levert wat we gewoonlijk als ‘perifeer zicht’ beschouwen, de dingen die we “in de hoek van ons oog” zien. Dit deel voelt bewegende voorwerpen heel goed, maar biedt niet genoeg resolutie om bijvoorbeeld een boek te lezen.

Het totale gezichtsveld (het gebied waarin we beweging kunnen zien) van het menselijk oog is 160 graden, maar buiten de kegel van visuele aandacht kunnen we niet echt details herkennen, alleen brede vormen en beweging.

De voordelen van het menselijk oog ten opzichte van de camera worden iets minder naarmate we het netvlies verlaten en terugreizen in de richting van de hersenen. De camera zendt de gegevens van elke pixel van de sensor naar een computerchip voor verwerking tot een beeld. Het oog heeft 130 miljoen sensoren in het netvlies, maar de oogzenuw die de signalen van die sensoren naar de hersenen leidt, heeft slechts 1,2 miljoen vezels, zodat minder dan 10% van de gegevens van het netvlies op een bepaald moment aan de hersenen wordt doorgegeven. (Deels komt dit doordat de chemische lichtsensoren in het netvlies er een tijdje over doen om zich op te laden nadat ze gestimuleerd zijn. Deels omdat de hersenen toch niet zoveel informatie zouden kunnen verwerken.)

![]()

En natuurlijk verwerken de hersenen de signalen heel anders dan een fotocamera. In tegenstelling tot de onderbroken sluiterklikken van een camera, zendt het oog de hersenen een constante videofeed die wordt verwerkt tot wat wij zien. Een onderbewust deel van de hersenen (de laterale nucleus geniculate, als u het weten wilt) vergelijkt de signalen van beide ogen, voegt de belangrijkste delen samen tot 3-D beelden, en stuurt ze door naar het bewuste deel van de hersenen voor beeldherkenning en verdere verwerking.

De onderbewuste hersenen sturen ook signalen naar het oog, waardoor de oogbol lichtjes beweegt in een scanpatroon, zodat het scherpe zicht van de macula over een interessant voorwerp beweegt. In een paar fractie van een seconde zendt het oog in feite meerdere beelden, en de hersenen verwerken die tot een vollediger en gedetailleerder beeld.

De onbewuste hersenen weigeren ook veel van de binnenkomende bandbreedte, en zenden slechts een klein deel van de gegevens door naar de bewuste hersenen. Je kunt dit tot op zekere hoogte controleren: bijvoorbeeld, op dit moment zegt je bewuste brein tegen de laterale nucleus geniculateus “stuur me alleen informatie van het centrale gezichtsveld, concentreer je op die getypte woorden in het midden van het gezichtsveld, beweeg van links naar rechts, zodat ik ze kan lezen”. Stop even met lezen en probeer zonder je ogen te bewegen te zien wat zich in je perifere gezichtsveld bevindt. Een seconde geleden “zag” u dat voorwerp rechts of links van het computerscherm niet omdat het perifere zicht niet werd doorgegeven aan het bewuste brein.

![]()

Als u zich concentreert, zelfs zonder uw ogen te bewegen, kunt u in ieder geval zien dat het voorwerp er is. Als u het echter duidelijk wilt zien, moet u een ander hersensignaal naar het oog sturen, waardoor de kegel van visuele aandacht naar dat object wordt verplaatst. Merk ook op dat u niet tegelijk de tekst kunt lezen en de voorwerpen aan de rand kunt zien – de hersenen kunnen niet zoveel gegevens verwerken.

De hersenen zijn nog niet klaar als het beeld het bewuste deel (de visuele cortex genoemd) heeft bereikt. Dit gebied staat in sterke verbinding met de geheugengedeelten van de hersenen, waardoor u voorwerpen in het beeld kunt ‘herkennen’. We hebben allemaal wel eens dat moment meegemaakt waarop we iets zien, maar een seconde of twee niet herkennen wat het is. Nadat we het hebben herkend, vragen we ons af waarom het in hemelsnaam niet onmiddellijk duidelijk was. Dat komt omdat de hersenen een fractie van een seconde nodig hadden om de geheugenbestanden voor beeldherkenning te openen. (Als u dit nog niet hebt meegemaakt, wacht dan een paar jaar. Dat komt nog wel.)

In werkelijkheid (en dit is heel duidelijk) is het menselijk gezichtsvermogen video, geen fotografie. Zelfs bij het staren naar een foto maken de hersenen meerdere ‘snapshots’ terwijl ze het brandpunt over het beeld bewegen, en deze stapelen en samenvoegen tot het uiteindelijke beeld dat we waarnemen. Kijk een paar minuten naar een foto en je zult je realiseren dat je oog onbewust over de foto is gegaan, een overzicht van het beeld heeft gekregen, zich hier en daar op details heeft geconcentreerd en zich na een paar seconden een aantal dingen realiseert die op het eerste gezicht niet duidelijk waren.

Dus waar gaat het om?

Wel, ik heb een paar observaties, hoewel ze ver verwijderd zijn van “welke lens heeft het gezichtsveld dat het meest overeenkomt met het menselijk zicht?”. Deze informatie zette me aan het denken over wat me zo gefascineerd maakt door sommige foto’s, en niet zozeer door andere. Ik weet niet of al deze observaties waar zijn, maar het zijn interessante gedachten (voor mij althans). Ze zijn allemaal gebaseerd op één feit: als ik een foto echt mooi vind, besteed ik er een minuut of twee aan om er naar te kijken, mijn menselijke visie de foto te laten scannen, de details eruit te halen of me misschien te verwonderen over de details die niet zichtbaar zijn.

Foto’s genomen onder een ‘normale’ beeldhoek (35mm tot 50mm) lijken hun aantrekkingskracht te behouden, ongeacht hun grootte. Zelfs foto’s op webformaat die met deze brandpuntsafstand zijn gemaakt, behouden de essentie van de opname. De opname hieronder (gemaakt op 35 mm) heeft veel meer detail wanneer hij in het groot wordt afgebeeld, maar de essentie is zelfs in het klein nog duidelijk. Misschien is de verwerking van de hersenen comfortabeler bij het herkennen van een beeld dat het in zijn normale gezichtsveld ziet. Misschien komt het omdat wij fotografen de neiging hebben om onbewust de nadruk te leggen op de compositie en de onderwerpen in een foto met een ‘normale’ beeldhoek.

![]()

De foto hierboven toont iets anders aan dat ik me altijd heb afgevraagd: ontstaat onze fascinatie en liefde voor zwart-witfotografie omdat het een van de weinige manieren is waarop de dichte kegelreceptoren (alleen kleur) in onze macula gedwongen worden om een beeld in grijstinten naar onze hersenen te sturen?

Misschien vinden onze hersenen het prettig om alleen naar kleur en textuur te kijken, zonder dat kleurgegevens die smalle bandbreedte tussen oogbol en hersenen verstoppen.

Net als ‘normale’ opnamen zien tele- en macro-opnamen er vaak geweldig uit in kleine afdrukken of JPG’s op web-formaat. Ik heb een 8 × 10 van een olifantenoog en een even grote macro-afdruk van een spin aan de muur van mijn kantoor die er zelfs van de andere kant van de kamer geweldig uitzien. (Tenminste, voor mij zien ze er goed uit, maar je zult zien dat ze in mijn kantoor hangen. Ik heb ze op een paar andere plaatsen in huis opgehangen en heb tactvol te horen gekregen dat “ze echt niet passen bij de meubels in de woonkamer”, dus misschien zien ze er niet voor iedereen zo geweldig uit.)

Er is geen geweldige compositie of andere factoren die deze foto’s voor mij aantrekkelijk maken, maar ik vind ze toch fascinerend. Misschien omdat zelfs op klein formaat mijn menselijke visie details in de foto kan zien die ik nooit zou kunnen zien als ik met het ‘blote oog’ naar een olifant of spin keek.

![]()

Aan de andere kant, als ik een goede groothoek- of landschapsopname krijg, neem ik nauwelijks de moeite om een afbeelding op webformaat te plaatsen of een kleine afdruk te maken (en daar ga ik voor dit artikel niet aan beginnen). Ik wil het GROOT afgedrukt hebben. Ik denk misschien zodat mijn menselijke visie door het beeld kan scannen en de kleine details eruit kan pikken die volledig verloren gaan wanneer het verkleind is. En elke keer als ik een grote afdruk maak, zelfs van een tafereel waar ik al een dozijn keer ben geweest, zie ik dingen op de foto die ik nooit heb gezien toen ik er zelf was.

Misschien dat de ‘video’ die mijn hersenen maken terwijl ik de afdruk scan, veel meer detail oplevert en ik het mooier vind dan de compositie van de foto zou geven wanneer hij klein is afgedrukt (of die ik zag toen ik daadwerkelijk ter plekke was).

En misschien verklaart het onbewuste ‘scannen’ dat mijn zicht over een foto maakt wel waarom dingen als de ‘regel van derden’ en selectieve focus mijn oog naar bepaalde delen van de foto trekken. Misschien hebben wij fotografen gewoon uitgevogeld hoe de hersenen beelden verwerken en daar door praktische ervaring ons voordeel mee gedaan, zonder alle wetenschap te kennen.

Maar ik denk dat mijn enige echte conclusie deze is: een foto is NIET precies wat mijn oog en hersenen zagen op de scène. Als ik een goede foto maak, is het iets anders en iets beters, zoals Winogrand zei in de twee citaten hierboven, en ook in dit citaat:

Je ziet iets gebeuren en je gaat ermee aan de slag. Of je krijgt wat je zag of je krijgt iets anders – en wat het beste is druk je af.

Over de auteur: Roger Cicala is de oprichter van LensRentals. Dit artikel was oorspronkelijk hier gepubliceerd.

Afbeeldingen: mijn oog van dichtbij door machinecodeblue, Nikh’s oog door camera’s oog van mijn ogen voor jouw ogen 🙂 door slalit, Schematische weergave van het menselijk oog door entirelysubjective, Mijn linker oog netvlies door Richard Masoner / Cyclelicious, Chromatische aberratie (soort van) door moppet65535