![]()

Cet article a commencé après que j’ai suivi une discussion en ligne sur la question de savoir si un objectif de 35 mm ou de 50 mm sur un appareil photo plein cadre donne le champ de vision équivalent à la vision humaine normale. Cette discussion particulière s’est immédiatement plongée dans la physique optique de l’œil en tant qu’appareil photo et objectif – une comparaison compréhensible puisque l’œil est constitué d’un élément frontal (la cornée), d’un anneau d’ouverture (l’iris et la pupille), d’un objectif et d’un capteur (la rétine).

Malgré toutes les mathématiques impressionnantes lancées à droite et à gauche concernant la physique optique du globe oculaire, la discussion ne semblait pas tout à fait avoir de sens logique, alors j’ai fait beaucoup de lectures de mon côté sur le sujet.

Il n’y aura pas de bénéfice direct de cet article qui vous permettra de courir prendre de meilleures photos, mais vous pourriez le trouver intéressant. Vous pouvez aussi le trouver incroyablement ennuyeux, alors je vous donnerai d’abord ma conclusion, sous la forme de deux citations de Garry Winogrand :

Une photographie est l’illusion d’une description littérale de la façon dont l’appareil photo a » vu » un morceau de temps et d’espace.

La photographie ne concerne pas la chose photographiée. Il s’agit de la façon dont cette chose semble photographiée.

Fondamentalement, en faisant toutes ces recherches sur la façon dont l’œil humain est comme un appareil photo, ce que j’ai vraiment appris, c’est que la vision humaine n’est pas comme une photographie. D’une certaine manière, cela m’a expliqué pourquoi je trouve si souvent une photographie beaucoup plus belle et intéressante que la scène elle-même.

L’œil comme système de caméra

![]()

Superficiellement, il est assez logique de comparer l’œil à une caméra. Nous pouvons mesurer la longueur avant-arrière de l’œil (environ 25 mm de la cornée à la rétine), et le diamètre de la pupille (2 mm contractée, 7 à 8 mm dilatée) et calculer des nombres semblables à ceux d’une lentille à partir de ces mesures.

Vous trouverez cependant des nombres différents cités pour la distance focale de l’œil. Certains proviennent de mesures physiques des structures anatomiques de l’œil, d’autres de calculs optométriques, certains prennent en compte le fait que la lentille de l’œil et la taille de l’œil lui-même changent avec les contractions de divers muscles.

Pour résumer, cependant, une longueur focale de l’œil couramment citée est de 17 mm (elle est calculée à partir de la valeur dioptrique optométrique). La valeur la plus communément acceptée, cependant, est de 22mm à 24mm (calculée à partir de la réfraction physique dans l’œil). Dans certaines situations, la distance focale peut en fait être plus longue.

Puisque nous connaissons la distance focale approximative et le diamètre de la pupille, il est relativement facile de calculer l’ouverture (f-stop) de l’œil. Compte tenu d’une longueur focale de 17 mm et d’une pupille de 8 mm, le globe oculaire devrait fonctionner comme un objectif f/2.1. Si nous utilisons une longueur focale de 24 mm et une pupille de 8 mm, l’ouverture devrait être de f/3,5. Il y a effectivement eu un certain nombre d’études faites en astronomie pour mesurer réellement le diaphragme de l’œil humain, et le nombre mesuré s’avère être f/3,2 à f/3,5 (Middleton, 1958).

![]()

À ce stade, les deux d’entre vous qui ont lu jusqu’ici se sont probablement demandé « Si la distance focale de l’œil est de 17 ou 24 mm, pourquoi tout le monde se dispute pour savoir si les objectifs de 35 mm ou de 50 mm ont le même champ de vision que l’œil humain ? »

La raison est que la distance focale mesurée de l’œil n’est pas ce qui détermine l’angle de vue de la vision humaine. J’y reviendrai plus en détail ci-dessous, mais le point principal est que seule une partie de la rétine traite l’image principale que nous voyons. (La zone de vision principale est appelée le cône d’attention visuelle, le reste de ce que nous voyons est la « vision périphérique »).

Des études ont mesuré le cône d’attention visuelle et ont trouvé qu’il avait une largeur d’environ 55 degrés. Sur un appareil photo 35 mm plein cadre, un objectif de 43 mm fournit un angle de vue de 55 degrés, donc cette longueur focale fournit exactement le même angle de vue que nous, les humains, avons. Bon sang, si ce n’est pas à mi-chemin entre 35 mm et 50 mm. Donc, l’argument original est terminé, l’objectif réel « normal » sur un SLR 35mm n’est ni 35mm ni 50mm, il est à mi-chemin entre les deux.

L’œil n’est pas un système de caméra

Ayant obtenu la réponse à la discussion originale, j’aurais pu laisser les choses tranquilles et partir avec encore un autre morceau de trivia assez inutile classé pour étonner mes amis en ligne avec. Mais NON. Quand j’ai un tas de travail à faire, je trouve que je choisirai presque toujours de passer quelques heures de plus à lire d’autres articles sur la vision humaine.

Vous avez peut-être remarqué que la section ci-dessus a laissé de côté certaines des analogies entre l’œil et l’appareil photo, parce qu’une fois que vous dépassez les mesures simples de l’ouverture et de l’objectif, le reste des comparaisons ne vont pas si bien.

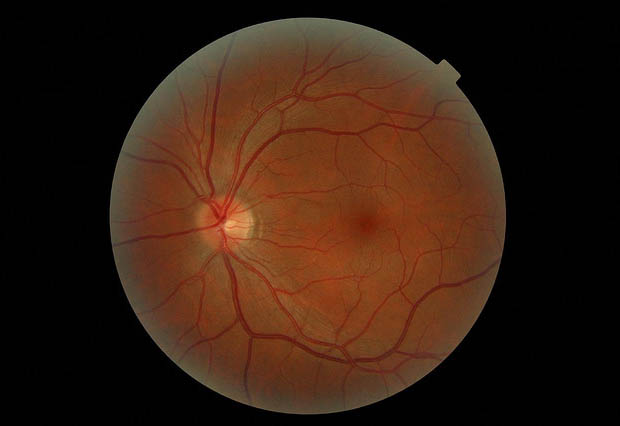

Pensez au capteur de l’œil, la rétine. La rétine a presque la même taille (32 mm de diamètre) que le capteur d’un appareil photo plein cadre (35 mm de diamètre). Après cela, cependant, presque tout est différent.

La première différence entre la rétine et le capteur de votre appareil photo est plutôt évidente : la rétine est incurvée le long de la surface arrière du globe oculaire, et non plate comme le capteur en silicium de l’appareil photo. Cette courbure présente un avantage évident : les bords de la rétine sont à peu près à la même distance de l’objectif que le centre. Sur un capteur plat, les bords sont plus éloignés de l’objectif, et le centre plus proche. Avantage de la rétine – elle devrait avoir une meilleure « netteté des coins ».

L’œil humain a également beaucoup plus de pixels que votre appareil photo, environ 130 millions de pixels (vous propriétaires d’appareils photo de 24 mégapixels vous sentez humbles maintenant ?). Cependant, seulement environ 6 millions des pixels de l’œil sont des cônes (qui voient la couleur), les 124 millions restants ne voient que le noir et le blanc. Mais avantage encore à la rétine. Big time.

Mais si nous regardons plus loin, les différences deviennent encore plus prononcées…

Sur un capteur d’appareil photo, chaque pixel est disposé selon un quadrillage régulier. Chaque millimètre carré du capteur a exactement le même nombre et le même motif de pixels. Sur la rétine, il y a une petite zone centrale d’environ 6 mm de diamètre (la macula) qui contient la concentration la plus dense de photorécepteurs de l’œil. La partie centrale de la macula (la fovéa) est densément peuplée uniquement de cellules coniques (qui détectent les couleurs). Le reste de la macula autour de cette zone centrale » couleur seulement » contient à la fois des bâtonnets et des cônes.

![]()

La macula contient environ 150 000 » pixels » dans chaque carré de 1 mm de côté (comparez cela aux 24 000 000 de pixels répartis sur un capteur de 35 mm x 24 mm dans un 5DMkII ou un D3x) et fournit notre » vision centrale » (le cône d’attention visuelle de 55 degrés mentionné ci-dessus). Quoi qu’il en soit, la partie centrale de notre champ visuel a une capacité de résolution bien supérieure à celle du meilleur appareil photo.

Le reste de la rétine comporte beaucoup moins de ‘pixels’, dont la plupart sont uniquement des capteurs noir et blanc. Il fournit ce que nous considérons habituellement comme la « vision périphérique », les choses que nous voyons « dans le coin de notre œil ». Cette partie détecte très bien les objets en mouvement, mais ne fournit pas une résolution suffisante pour lire un livre, par exemple.

Le champ de vision total (la zone dans laquelle nous pouvons voir le mouvement) de l’œil humain est de 160 degrés, mais en dehors du cône d’attention visuelle, nous ne pouvons pas vraiment reconnaître les détails, seulement les grandes formes et le mouvement.

Les avantages de l’œil humain par rapport à la caméra se réduisent un peu lorsque nous quittons la rétine et remontons vers le cerveau. L’appareil photo envoie les données de chaque pixel du capteur à une puce informatique qui les traite pour en faire une image. L’œil compte 130 millions de capteurs dans la rétine, mais le nerf optique qui transmet les signaux de ces capteurs au cerveau ne compte que 1,2 million de fibres, de sorte que moins de 10 % des données de la rétine sont transmises au cerveau à un moment donné. (Cela s’explique en partie par le fait que les capteurs chimiques de lumière de la rétine mettent un certain temps à se « recharger » après avoir été stimulés. En partie parce que le cerveau ne pourrait pas traiter autant d’informations de toute façon.)

![]()

Et bien sûr, le cerveau traite les signaux de manière très différente d’un appareil photo. Contrairement aux clics intermittents de l’obturateur d’un appareil photo, l’œil envoie au cerveau un flux vidéo constant qui est traité pour donner ce que nous voyons. Une partie subconsciente du cerveau (le noyau géniculé latéral si vous voulez savoir) compare les signaux des deux yeux, assemble les parties les plus importantes en images 3D et les envoie à la partie consciente du cerveau pour la reconnaissance de l’image et le traitement ultérieur.

Le cerveau subconscient envoie également des signaux à l’œil, déplaçant légèrement le globe oculaire dans un schéma de balayage afin que la vision nette de la macula se déplace sur un objet d’intérêt. Pendant quelques secondes fractionnées, l’œil envoie en fait plusieurs images, et le cerveau les traite en une image plus complète et détaillée.

Le cerveau subconscient rejette également une grande partie de la bande passante entrante, n’envoyant qu’une petite fraction de ses données au cerveau conscient. Vous pouvez contrôler cela dans une certaine mesure : par exemple, en ce moment, votre cerveau conscient dit au noyau géniculé latéral « envoie-moi les informations de la vision centrale uniquement, concentre-toi sur ces mots tapés au centre du champ de vision, bouge de gauche à droite pour que je puisse les lire ». Arrêtez de lire pendant une seconde et, sans bouger les yeux, essayez de voir ce qui se trouve dans votre champ de vision périphérique. Il y a une seconde, vous n’avez pas « vu » cet objet à droite ou à gauche de l’écran d’ordinateur parce que la vision périphérique n’était pas transmise au cerveau conscient.

![]()

Si vous vous concentrez, même sans bouger les yeux, vous pouvez au moins dire que l’objet est là. Mais si vous voulez le voir clairement, vous devrez envoyer un autre signal cérébral à l’œil, déplaçant le cône d’attention visuelle sur cet objet. Remarquez également que vous ne pouvez pas à la fois lire le texte et voir les objets périphériques – le cerveau ne peut pas traiter autant de données.

Le cerveau n’a pas terminé lorsque l’image a atteint la partie consciente (appelée cortex visuel). Cette zone est fortement connectée aux parties du cerveau liées à la mémoire, ce qui vous permet de » reconnaître » les objets de l’image. Nous avons tous connu ce moment où nous voyons quelque chose, mais ne reconnaissons pas ce que c’est pendant une seconde ou deux. Après l’avoir reconnu, nous nous demandons pourquoi ce n’était pas évident immédiatement. C’est parce que le cerveau a eu besoin d’une fraction de seconde pour accéder aux fichiers de mémoire pour la reconnaissance des images. (Si vous n’en avez pas encore fait l’expérience, attendez quelques années, ça viendra.)

En réalité (et c’est très évident), la vision humaine est une vidéo, pas une photographie. Même en fixant une photographie, le cerveau prend de multiples » instantanés » en déplaçant le centre de la focalisation sur l’image, les empilant et les assemblant dans l’image finale que nous percevons. Regardez une photographie pendant quelques minutes et vous vous rendrez compte qu’inconsciemment votre œil a dérivé sur l’image, obtenant une vue d’ensemble de l’image, se focalisant sur des détails ici et là et, après quelques secondes, réalisant certaines choses à son sujet qui n’étaient pas évidentes au premier coup d’œil.

So What’s the Point?

Bien, j’ai quelques observations, bien qu’elles soient loin de « quel objectif a le champ de vision le plus similaire à la vision humaine ? ». Cette information m’a fait réfléchir à ce qui fait que je suis si fasciné par certaines photographies, et pas tellement par d’autres. Je ne sais pas si toutes ces observations sont vraies, mais ce sont des réflexions intéressantes (pour moi en tout cas). Elles reposent toutes sur un fait : quand j’aime vraiment une photographie, je passe une minute ou deux à la regarder, à laisser ma vision humaine la balayer, à en saisir les détails ou peut-être à m’interroger sur les détails qui ne sont pas visibles.

Les photographies prises à un angle de vue « normal » (35 mm à 50 mm) semblent conserver leur attrait quelle que soit leur taille. Même les images de taille web prises à cette focale conservent l’essence de la prise de vue. La photo ci-dessous (prise à 35 mm) est beaucoup plus détaillée lorsqu’elle est vue en grand format, mais son essence est évidente même en petit format. Peut-être le traitement du cerveau est-il plus à l’aise pour reconnaître une image qu’il voit dans son champ de vision normal. Peut-être est-ce parce que nous, photographes, avons tendance à mettre inconsciemment l’accent sur la composition et les sujets dans une photographie à angle de vue « normal ».

![]()

La photo ci-dessus démontre quelque chose d’autre que je me suis toujours demandé : notre fascination et notre amour pour la photographie en noir et blanc se produisent-ils parce que c’est l’une des rares façons dont les récepteurs à cône dense (couleur uniquement) de notre macula sont forcés d’envoyer une image en niveaux de gris à notre cerveau ?

Peut-être que notre cerveau aime regarder uniquement le ton et la texture, sans que les données de couleur n’encombrent cette bande passante étroite entre le globe oculaire et le cerveau.

Comme les prises de vue » à angle normal « , les téléobjectifs et les macrophotographies sont souvent superbes en petits tirages ou en JPG de taille web. J’ai un 8 × 10 d’un œil d’éléphant et une impression macro de taille similaire d’une araignée sur le mur de mon bureau qui, même de l’autre côté de la pièce, ont l’air superbes. (Du moins, elles me paraissent superbes, mais vous remarquerez qu’elles sont accrochées dans mon bureau. Je les ai accrochées à quelques autres endroits de la maison et on m’a dit avec tact qu' »elles ne vont vraiment pas avec les meubles du salon », alors peut-être qu’elles n’ont pas l’air si géniales pour tout le monde.)

Il n’y a pas de grande composition ou d’autres facteurs qui rendent ces photos attrayantes pour moi, mais je les trouve quand même fascinantes. Peut-être parce que même à une petite taille, ma vision humaine peut voir des détails dans la photographie que je ne pourrais jamais voir en regardant un éléphant ou une araignée à » l’œil nu « .

![]()

D’autre part, lorsque j’obtiens un bon grand angle ou une photo panoramique, je ne me donne même pas la peine de poster un graphique de taille web ou de faire une petite impression (et je ne vais pas commencer pour cet article). Je veux qu’elle soit imprimée en GRAND. Je pense que c’est peut-être pour que ma vision humaine puisse parcourir l’image et repérer les petits détails qui sont complètement perdus lorsqu’elle est réduite. Et chaque fois que je fais un grand tirage, même d’une scène où je suis allé une douzaine de fois, je remarque des choses dans la photographie que je n’ai jamais vues quand j’étais là en personne.

Peut-être que la ‘vidéo’ que mon cerveau fait en balayant le tirage fournit beaucoup plus de détails et je trouve cela plus agréable que ce que la composition de la photo donnerait quand elle est imprimée en petit (ou que je voyais quand j’étais réellement sur la scène).

Et peut-être que le « balayage » subconscient que ma vision fait à travers une photographie explique pourquoi des choses comme la « règle des tiers » et la focalisation sélective attirent mon œil vers certaines parties de la photographie. Peut-être que nous, photographes, avons simplement compris comment le cerveau traite les images et en avons tiré parti par l’expérience pratique, sans connaître toute la science impliquée.

Mais je suppose que ma seule véritable conclusion est la suivante : une photographie n’est PAS exactement ce que mon œil et mon cerveau ont vu sur les lieux. Quand j’obtiens une bonne photo, c’est quelque chose de différent et quelque chose de mieux, comme ce que Winogrand a dit dans les deux citations ci-dessus, et dans cette citation aussi :

Vous voyez quelque chose se produire et vous tapez dessus. Soit vous obtenez ce que vous avez vu, soit vous obtenez autre chose – et ce qui est mieux, vous imprimez.

À propos de l’auteur : Roger Cicala est le fondateur de LensRentals. Cet article a été initialement publié ici.

Crédits images : mon œil de près par machinecodeblue, Nikh’s eye through camera’s eye from my eyes for your eyes 🙂 par slalit, Schematic of the Human Eye par entirelysubjective, My left eye retina par Richard Masoner / Cyclelicious, Chromatic aberration (sort of) par moppet65535

.